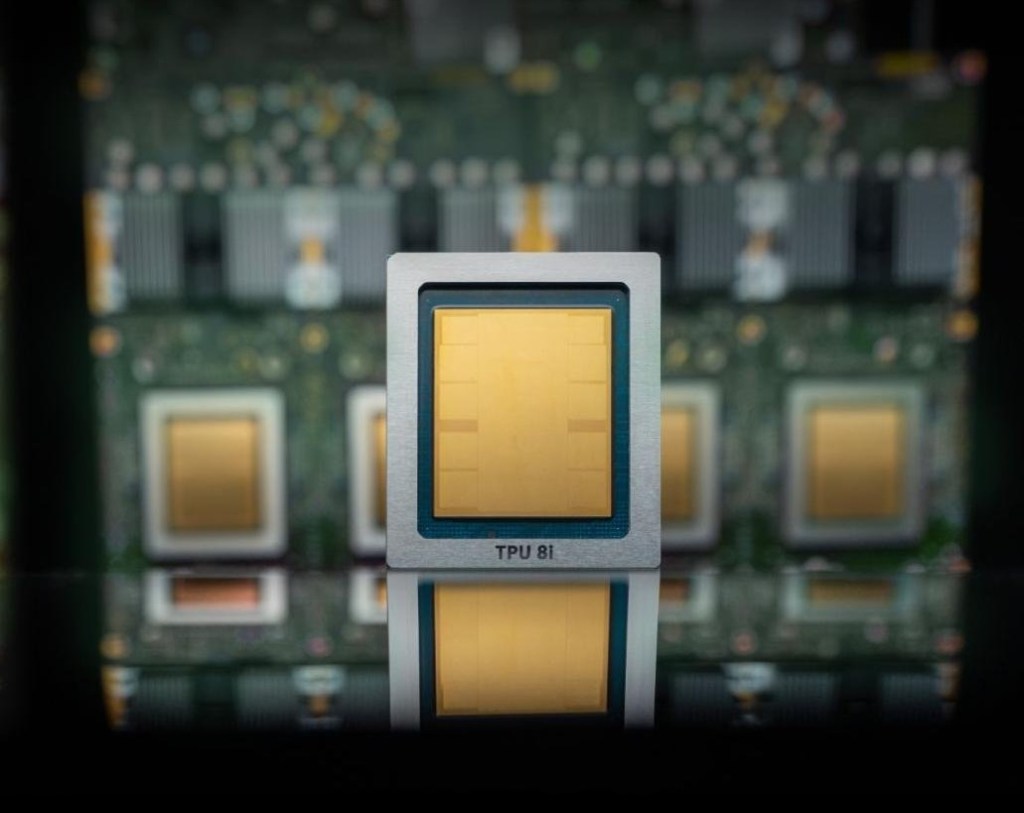

Google Cloud в среду объявила, что восьмое поколение ее фирменных AI-чипов, или tensor processing units (TPU), будет разделено на два направления. Один чип, TPU 8t, будет предназначен для обучения моделей, а другой, TPU 8i, — для inference.

Inference — это постоянное использование моделей, то есть то, что происходит после того, как пользователи отправляют промпты.

Как и следовало ожидать, компания заявляет о впечатляющих характеристиках новых TPU по сравнению с предыдущими поколениями: до 3x более быстрое обучение AI-моделей, на 80% более высокая производительность на доллар и возможность объединять более 1 млн TPU в один кластер. В результате должно получиться значительно больше вычислительных мощностей при заметно меньшем энергопотреблении — и меньших затратах для клиентов — чем у предыдущих версий. Компания называет эти чипы TPU, а не GPU, потому что ее собственные маломощные чипы изначально получили название Tensor.

Но чипы Google пока не означают полномасштабную атаку на будущее Nvidia. Как и другие крупные облачные провайдеры, включая Microsoft и Amazon, Google использует эти чипы как дополнение к системам на базе Nvidia, которые она предлагает в своей инфраструктуре. Речь не идет о полном отказе от Nvidia. Более того, Google обещает, что в ее облаке позже в этом году станет доступен новейший чип Nvidia — Vera Rubin.

Со временем hyperscalers, которые разрабатывают собственные AI-чипы, включая Amazon, Microsoft и Google, могут начать нуждаться в Nvidia меньше, по мере того как компании будут переносить свои AI-задачи в облака и адаптировать приложения под эти чипы.

Если все пойдет по плану Nvidia, рост Google как AI-cloud-провайдера приведет к росту бизнеса для производителя чипов, а не к его снижению, даже если значительная часть нагрузок будет выполняться на чипах Google.

Techcrunch event

Познакомьтесь со следующим инвестором или стартапом из вашего портфеля на Disrupt

Ваш следующий раунд. Ваш следующий найм. Ваша следующая возможность прорыва. Найдите ее на TechCrunch Disrupt 2026, где более 10 000 основателей, инвесторов и лидеров технологий соберутся на три дня, чтобы посетить более 250 практических сессий, полезные знакомства и инновации, задающие рынок. Зарегистрируйтесь сейчас и сэкономьте до $410.

Познакомьтесь со следующим инвестором или стартапом из вашего портфеля на Disrupt

Ваш следующий раунд. Ваш следующий найм. Ваша следующая возможность прорыва. Найдите ее на TechCrunch Disrupt 2026, где более 10 000 основателей, инвесторов и лидеров технологий соберутся на три дня, чтобы посетить более 250 практических сессий, полезные знакомства и инновации, задающие рынок. Зарегистрируйтесь сейчас и сэкономьте до $410.

Сан-Франциско, Калифорния | 13–15 октября 2026 года

Кроме того, Google сообщает, что договорилась с Nvidia о совместной работе над сетевой инфраструктурой, которая позволит системам на базе Nvidia работать в ее облаке еще эффективнее. В частности, две компании работают над усилением программно-определяемой сетевой технологии Falcon, которую Google создала и открыла в 2023 году под эгидой Open Compute Project — организации, которую часто называют главным объединением open source-инициатив в области аппаратного обеспечения для дата-центров, Open Compute Project.

Материал — перевод статьи с английского.

Оригинал: Google Cloud launches two new AI chips to compete with Nvidia